Nhiều người khi bắt đầu làm việc với AI thường yêu cầu hệ thống “hãy tưởng tượng bạn là một chuyên gia” trong lĩnh vực họ muốn. Tuy nhiên, các nhà nghiên cứu cho rằng kỹ thuật này có thể không mang lại hiệu quả như kỳ vọng.

Persona-based prompting – tức là đưa vào prompt những chỉ dẫn kiểu như “Bạn là một lập trình viên machine learning chuyên gia” – đã xuất hiện từ năm 2023, khi các nhà nghiên cứu bắt đầu khám phá cách những chỉ dẫn đóng vai (role-playing) ảnh hưởng đến đầu ra của mô hình AI.

Hiện nay, không khó để thấy các hướng dẫn viết prompt trên mạng có những câu như: “Bạn là một lập trình viên full-stack chuyên gia, được giao nhiệm vụ xây dựng một ứng dụng web full-stack hoàn chỉnh, sẵn sàng production từ đầu.”

Tuy nhiên, các học giả đã nghiên cứu phương pháp này cho biết nó không phải lúc nào cũng mang lại kết quả tốt hơn.

Trong một bài nghiên cứu dạng pre-print có tiêu đề "Expert Personas Improve LLM Alignment but Damage Accuracy: Bootstrapping Intent-Based Persona Routing with PRISM", các nhà nghiên cứu liên kết với University of Southern California (USC) nhận thấy rằng persona-based prompting phụ thuộc vào từng loại nhiệm vụ — điều này giải thích vì sao kết quả lại không đồng nhất.

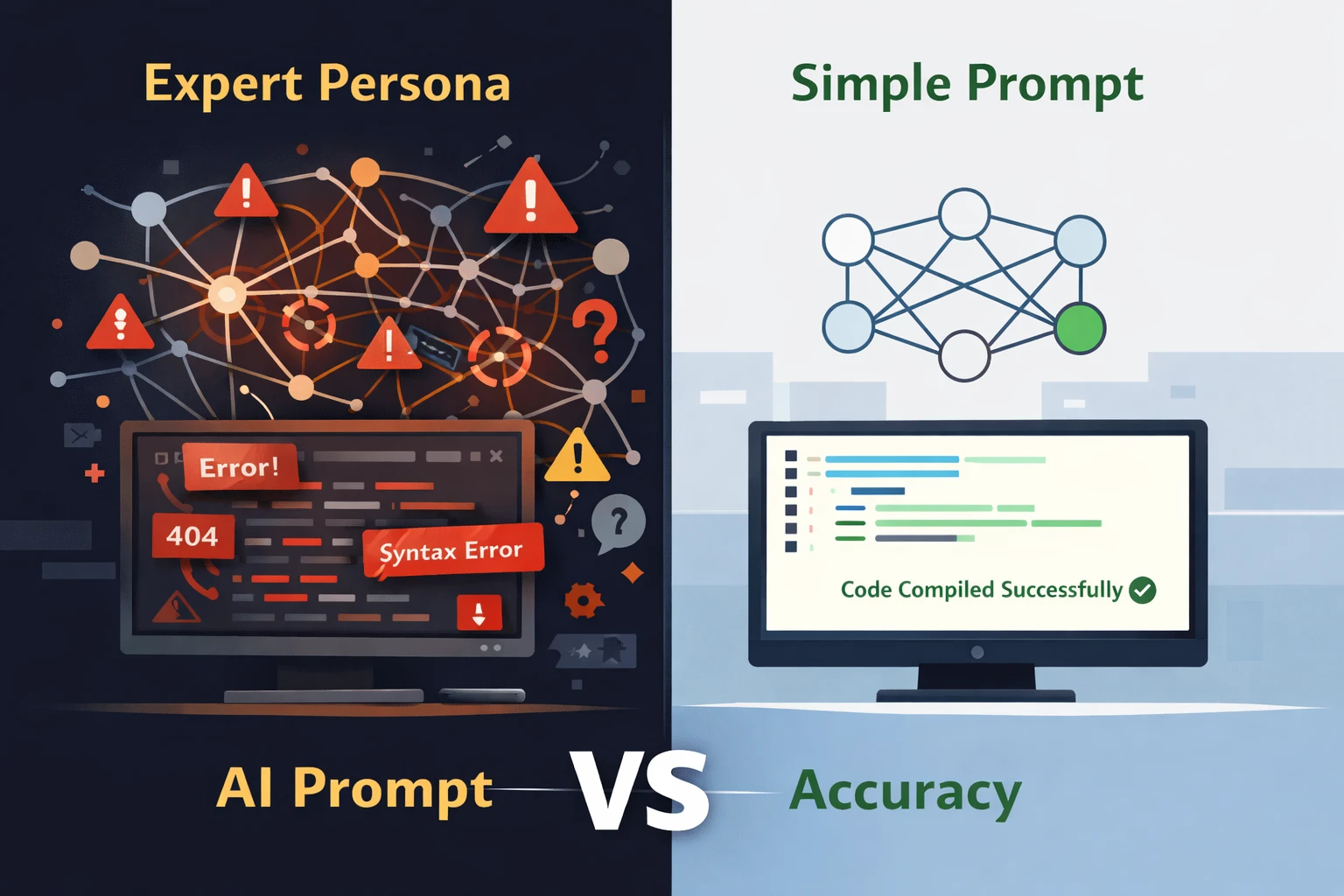

Với các nhiệm vụ phụ thuộc vào alignment (sự tuân thủ yêu cầu), như viết nội dung, nhập vai, hay đảm bảo an toàn, việc sử dụng persona giúp cải thiện hiệu suất của mô hình. Nhưng với các nhiệm vụ phụ thuộc vào dữ liệu pretraining như toán học và lập trình, kỹ thuật này lại làm kết quả tệ hơn.

Lý do là việc nói với mô hình rằng nó là “chuyên gia” không thực sự cung cấp thêm kiến thức — không có dữ liệu mới nào được thêm vào quá trình huấn luyện.

Thậm chí, việc gán cho mô hình vai trò chuyên gia trong một lĩnh vực cụ thể còn làm giảm khả năng truy xuất thông tin từ dữ liệu đã học trước đó.

Các nhà nghiên cứu đã sử dụng benchmark Measuring Massive Multitask Language Understanding (MMLU) — một phương pháp đánh giá hiệu suất của LLM — để kiểm tra persona-based prompting. Họ phát hiện rằng:

“khi LLM được yêu cầu chọn đáp án trong câu hỏi trắc nghiệm, persona ‘chuyên gia’ luôn cho kết quả kém hơn mô hình gốc ở cả bốn nhóm chủ đề (độ chính xác tổng thể: 68.0% so với 71.6% của mô hình gốc). Một cách giải thích có thể là các tiền tố persona kích hoạt chế độ ‘làm theo chỉ dẫn’, vốn lẽ ra được dùng cho việc truy xuất kiến thức.”

Tuy nhiên, việc sử dụng persona lại giúp điều hướng mô hình đưa ra các câu trả lời phù hợp hơn với các tiêu chí alignment. Ví dụ, nhóm tác giả cho biết:

“Một persona ‘Safety Monitor’ chuyên biệt giúp tăng tỷ lệ từ chối các yêu cầu tấn công trên cả ba benchmark an toàn, với mức cải thiện lớn nhất trên JailbreakBench (+17.7 điểm phần trăm, từ 53.2% lên 70.9%).”

Zizhao Hu, nghiên cứu sinh tiến sĩ tại USC và là một trong các đồng tác giả, chia sẻ với The Register rằng theo kết quả nghiên cứu, việc yêu cầu AI đóng vai một lập trình viên chuyên gia không giúp cải thiện chất lượng hoặc tính hữu dụng của mã nguồn.

Tuy nhiên, dựa trên các hướng dẫn prompt phổ biến, Hu cho biết:

“nhiều yếu tố khác như sở thích UI, kiến trúc dự án, hay lựa chọn công cụ lại thiên về alignment — và những yếu tố này thực sự được hưởng lợi từ việc mô tả persona chi tiết.”

Ông nói thêm:

“Trong các ví dụ đã đưa ra, chúng tôi cho rằng persona chuyên gia chung chung là không cần thiết, chẳng hạn như ‘Bạn là một lập trình viên full-stack chuyên gia’. Thay vào đó, các yêu cầu dự án được cá nhân hóa chi tiết có thể giúp mô hình tạo ra code phù hợp hơn với nhu cầu người dùng.”

Nhận thấy persona vẫn có tác động nhất định, các nhà nghiên cứu — Hu cùng các cộng sự Mohammad Rostami và Jesse Thomason — đã đề xuất một kỹ thuật mang tên PRISM (Persona Routing via Intent-based Self-Modeling), nhằm tận dụng lợi ích của persona mà không gây ra tác hại.

Ông giải thích:

“Chúng tôi sử dụng cơ chế gated LoRA (low-rank adaptation), trong đó mô hình gốc được giữ nguyên và được dùng cho những tác vụ phụ thuộc vào kiến thức đã được huấn luyện trước. Quyết định này được học bởi một ‘gate’.”

Adapter LoRA sẽ được kích hoạt trong những trường hợp hành vi dựa trên persona giúp cải thiện đầu ra, và trong các trường hợp khác, hệ thống sẽ quay lại sử dụng mô hình gốc chưa chỉnh sửa.

Nhóm nghiên cứu thiết kế PRISM để tránh những đánh đổi (trade-off) của các phương pháp khác — như prompt-based routing (áp dụng persona tại thời điểm suy luận) và supervised fine-tuning (nhúng hành vi trực tiếp vào trọng số của mô hình).

Khi được hỏi liệu có thể đưa ra nguyên tắc chung cho việc viết prompt hiệu quả hay không, Hu trả lời:

“Chúng tôi chưa thể khẳng định cho mọi trường hợp, nhưng từ phát hiện về persona chuyên gia, có một điểm đáng chú ý là: ‘Nếu bạn quan tâm nhiều hơn đến alignment (an toàn, quy tắc, tuân thủ cấu trúc, v.v.), hãy mô tả yêu cầu thật cụ thể; còn nếu bạn ưu tiên độ chính xác và tính đúng đắn của thông tin, thì đừng thêm gì cả — chỉ cần gửi câu hỏi.’”