Để đánh giá một model tóm tắt văn bản ta có thể dùng thước đo ROUGE

ROUGE (Recall-Oriented Understudy for Gisting Evaluation) đo lường độ chính xác của các hệ thống tóm tắt bằng cách so sánh giữa văn bản tóm tắt tự động và văn bản tóm tắt tham chiếu, thường được tạo bởi con người.

Rouge-N: đo số lượng n-gram phù hợp giữa văn bản do mô hình tạo ra và tham chiếu do con người tạo ra.

VD: Ta xem xét ví dụ mẫu trong đó R là tài liệu tham khảo, C là bản tóm tắt.

• R: The cat is on the mat.

• C: The cat and the dog.

ROUGE-1 Với ROUGE-1 ta xét theo từng từ đơn (gram)

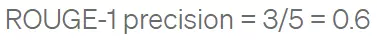

Độ chính xác (precision) của ROUGE-1 có thể được tính bằng tỷ lệ giữa số unigram trong C cũng xuất hiện trong R (tức là các từ “the”, “cat” và “the”) trên số unigram trong C.

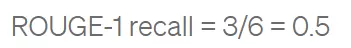

ROUGE-1 recall có thể được tính bằng tỷ số giữa số unigram trong R cũng xuất hiện trong C (tức là các từ “the”, “cat” và “the”) trên số unigram trong R.

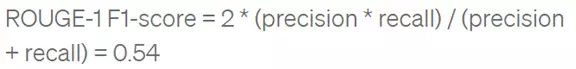

ROUGE-1 F1-score có thể được lấy trực tiếp từ độ chính xác ROUGE-1 và thu hồi bằng công thức điểm F1 tiêu chuẩn.

ROUGE-2 Tính toán ROUGE-2 có trọng lượng 2 grams. ROUGE-2 precision là tỷ số giữa số 2 gam trong C cũng xuất hiện trong R (chỉ có 2 gam “con mèo”) trên số 2 gam trong C.

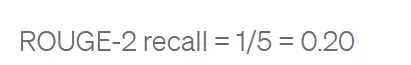

ROUGE-2 recall là tỷ số giữa số 2 gam trong R cũng xuất hiện trong C (chỉ có 2 gam “con mèo”) trên số 2 gam trong R.

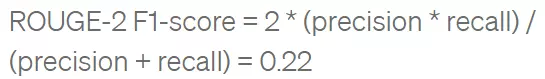

Do đó F1-Score được tính :

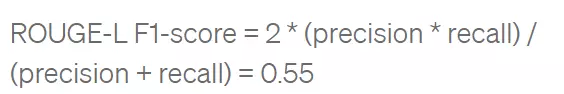

ROUGE-L ROUGE-L dựa trên chuỗi con chung dài nhất (LCS) giữa đầu ra mô hình và tham chiếu của chúng tôi, tức là chuỗi từ dài nhất (không nhất thiết phải liên tiếp nhưng vẫn theo thứ tự) được chia sẻ giữa cả hai. Trình tự được chia sẻ dài hơn sẽ biểu thị nhiều điểm giống nhau hơn giữa hai trình tự.

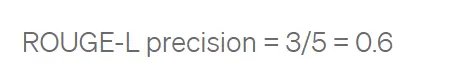

LCS là 3 gram “the cat the” (hãy nhớ rằng các từ không nhất thiết phải liên tiếp), xuất hiện trong cả R và C. ROUGE-L precision là tỷ lệ giữa độ dài của LCS, trên số đơn vị trong C.

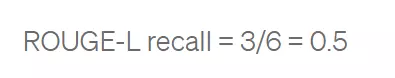

ROUGE-L recall là tỷ lệ giữa độ dài của LCS trên số đơn vị trong R.

ROUGE-S ROUGE-S là một phương pháp cho phép chúng ta áp dụng một mức độ khoan dung cho việc khớp n-gram được thực hiện bằng ROUGE-N và ROUGE-L. ROUGE-S là một độ đo đồng xuất hiện skip-gram: điều này cho phép tìm kiếm các từ liền kề từ văn bản tham chiếu xuất hiện trong đầu ra của mô hình nhưng được phân cách bởi một hoặc nhiều từ khác.

Nếu chúng ta xem xét “con mèo” 2 gram, thì thước đo ROUGE-2 sẽ chỉ khớp với nó nếu nó xuất hiện chính xác trong C, nhưng trường hợp này không xảy ra vì C chứa “con mèo xám”. Tuy nhiên, sử dụng ROUGE-S bỏ qua unigram, “con mèo” cũng sẽ khớp với “con mèo xám”. Các thông số của ROUGE-S cũng được tính theo cách tương tự như các số liệu ROUGE khác.