Chỉ có 35% lãnh đạo kỹ thuật báo cáo rằng họ đạt được ROI đáng kể từ AI, và hầu hết các mô hình đo lường ROI hiện tại đều bỏ sót phần quan trọng của bức tranh.

Phần lớn thời gian của đội ngũ kỹ thuật không nằm ở việc viết code, mà là xử lý cảnh báo, chẩn đoán sự cố và phối hợp quyết định giữa nhiều công cụ không chia sẻ cùng một ngữ cảnh. Chi phí cho những công việc này hiếm khi được tính vào mô hình ROI.

Khi tổ chức chỉ đo lường chi phí tạo ra code, họ đang bỏ qua các chi phí phát sinh phía sau trong môi trường production.

Các đội kỹ thuật tại Zscaler, DoorDash và Salesforce đang đo lường ROI của AI trên toàn bộ vòng đời phát triển phần mềm và nhận ra rằng lợi ích lớn nhất nằm ở giai đoạn production.

Khi OpenAI ra mắt Codex, một coding agent chạy trên nền tảng cloud, những bài toán khó nhất mà họ phải giải quyết gần như không liên quan trực tiếp đến mô hình AI.

Mô hình cốt lõi, codex-1, là một phiên bản của o3 được tinh chỉnh cho kỹ thuật phần mềm. Nó quan trọng, nhưng chỉ là một phần trong một hệ thống lớn hơn rất nhiều. Phần kỹ thuật thực sự nằm ở toàn bộ hệ thống xung quanh.

Làm thế nào để xây dựng một prompt đúng từ nhiều nguồn khác nhau? Điều gì xảy ra khi lịch sử hội thoại trở nên quá dài và vượt giới hạn bộ nhớ của mô hình? Làm sao để cùng một agent có thể hoạt động trong terminal, trình duyệt web và nhiều IDE khác nhau mà không cần viết lại?

Khi đội ngũ Codex cần tích hợp agent vào VS Code, họ đã thử cách rõ ràng nhất: sử dụng MCP — tiêu chuẩn đang nổi cho việc kết nối AI với công cụ. Nhưng nó không hoạt động.

Các tương tác thực tế mà một agent cần—như streaming tiến trình, tạm dừng giữa chừng để xin xác nhận từ người dùng, hay trả về diff code—không phù hợp với MCP. Vì vậy, họ đã xây dựng một giao thức hoàn toàn mới từ đầu.

Bài viết này sẽ đi sâu vào cách OpenAI xây dựng lớp orchestration xung quanh mô hình.

Lưu ý: Nội dung dựa trên thông tin công khai từ đội ngũ kỹ thuật OpenAI.

Codex là gì?

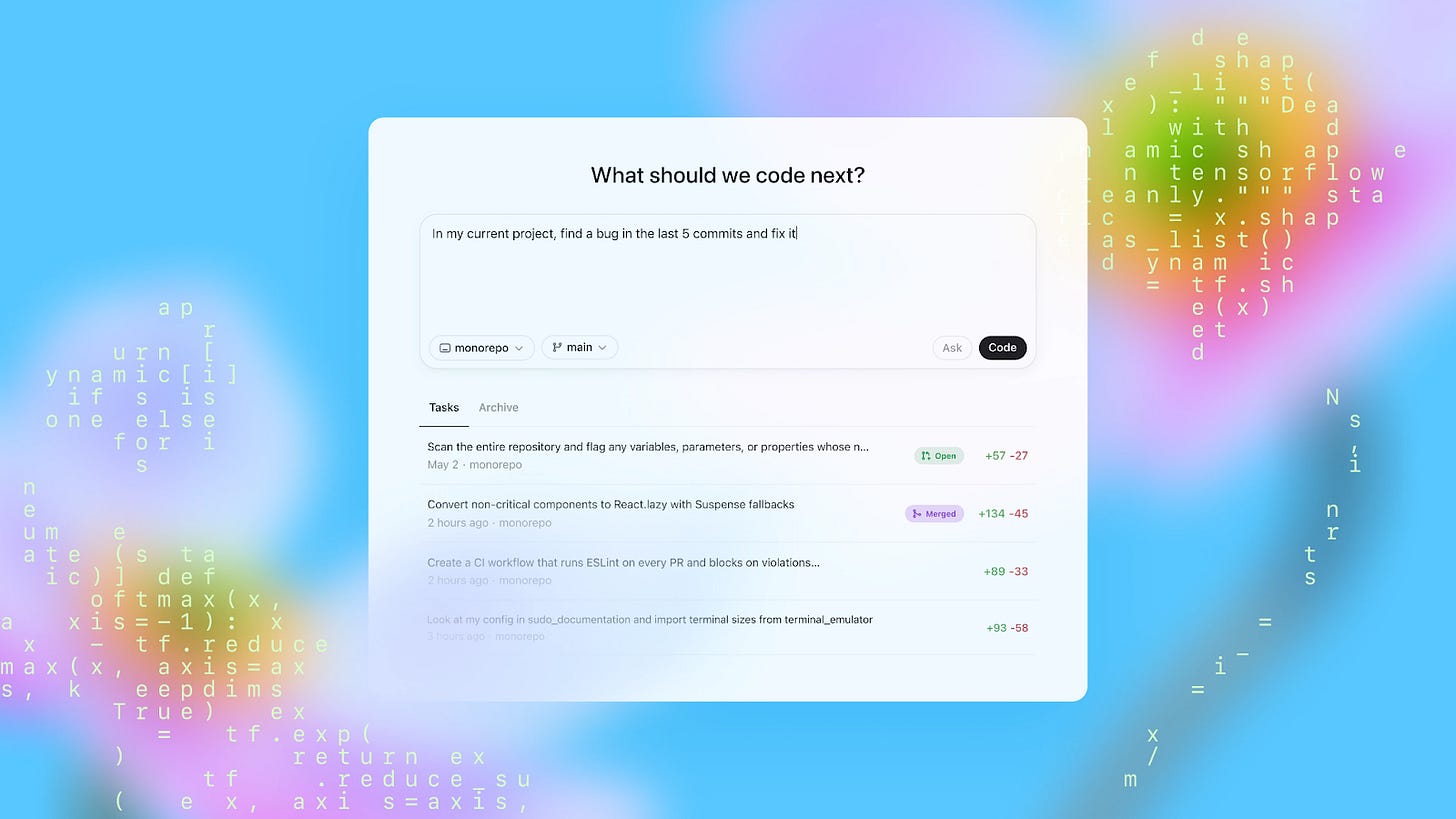

Codex là một coding agent có thể viết tính năng, sửa lỗi, trả lời câu hỏi về codebase và đề xuất pull request.

Nguồn: OpenAI Engineering Blog

Mỗi tác vụ chạy trong một sandbox cloud riêng biệt, được nạp sẵn repository của bạn. Bạn có thể chạy nhiều tác vụ song song và theo dõi tiến trình theo thời gian thực.

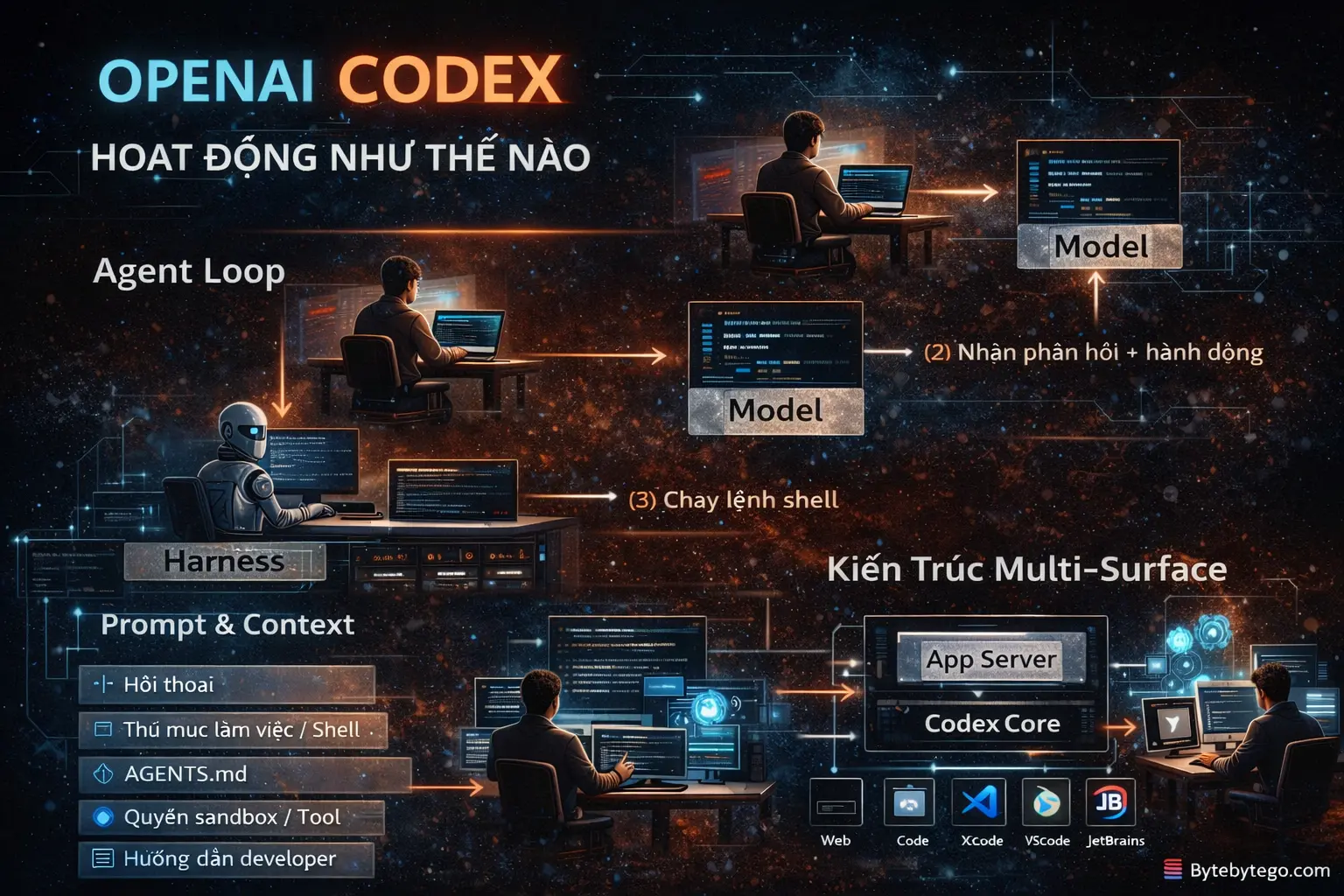

Hệ thống Codex có ba lớp chính: vòng lặp agent, quản lý prompt và bộ nhớ, và kiến trúc đa nền tảng.

Vòng lặp Agent

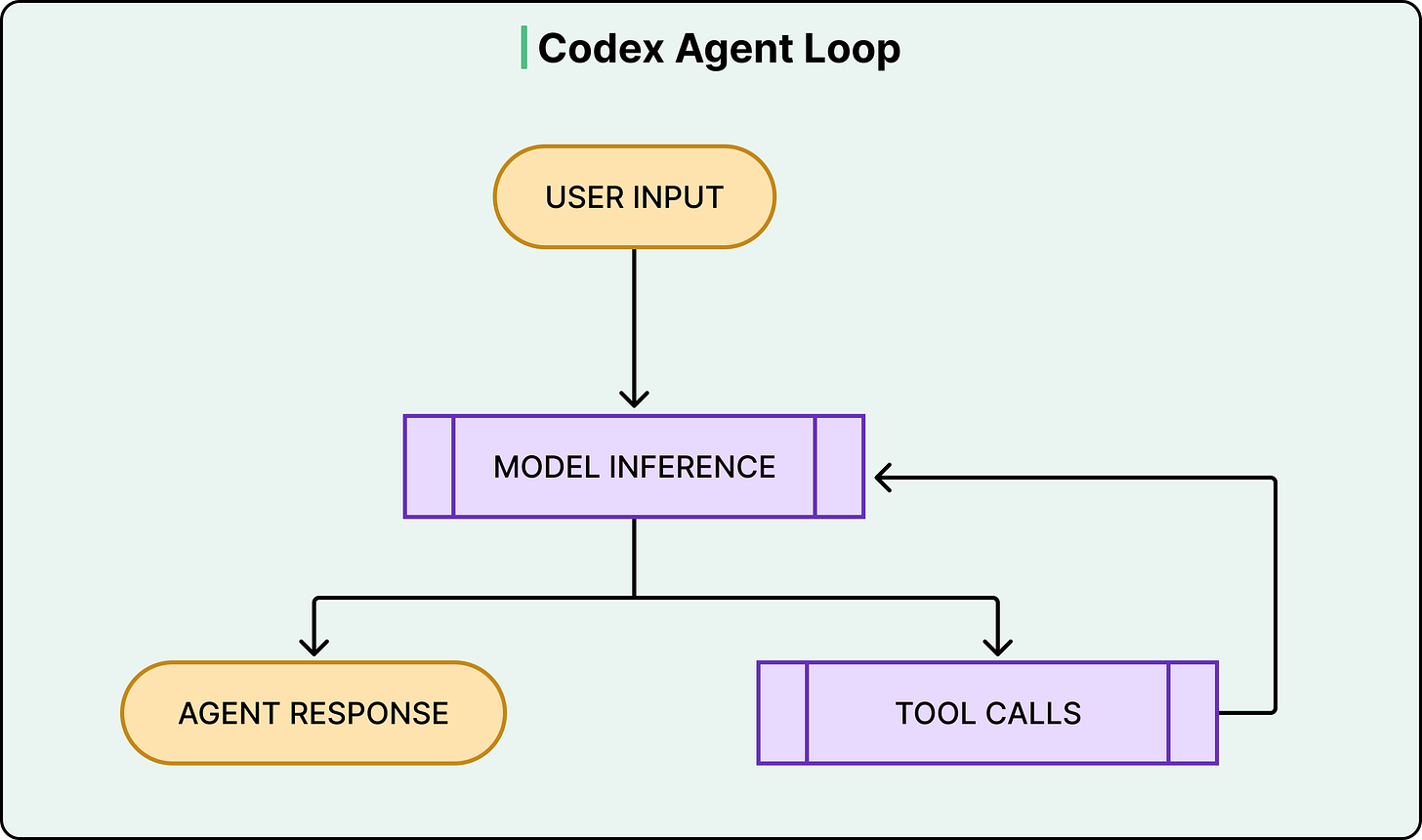

Trung tâm của Codex là agent loop. Agent nhận input từ người dùng, tạo prompt, gửi đến model và nhận lại phản hồi.

Nhưng phản hồi không phải lúc nào cũng là câu trả lời cuối cùng. Thường thì model yêu cầu thực hiện hành động, ví dụ: chạy lệnh shell.

Agent sẽ thực thi lệnh, thêm kết quả vào prompt và tiếp tục gửi lại cho model. Quá trình này lặp lại nhiều lần cho đến khi hoàn thành.

Hệ thống có thể đọc file, chỉnh sửa code, chạy test, lint và kiểm tra kiểu dữ liệu.

Một yêu cầu như “sửa bug” có thể dẫn đến nhiều bước: đọc code, chạy test, sửa lỗi, chạy lại test và tiếp tục cho đến khi pass.

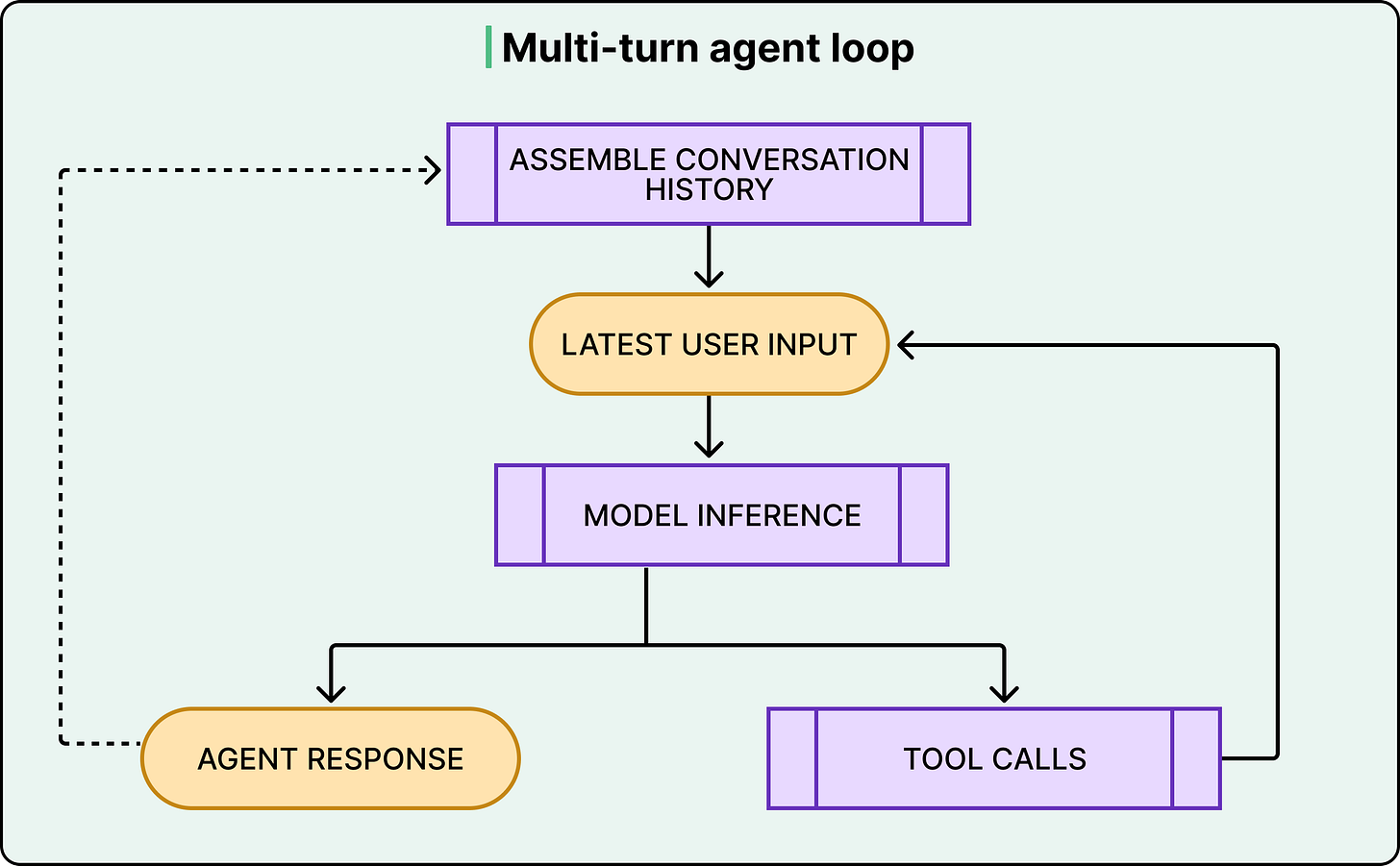

Mỗi chu kỳ này gọi là một “turn”. Toàn bộ lịch sử turn sẽ được đưa vào prompt ở lần tiếp theo.

Xây dựng prompt và quản lý bộ nhớ

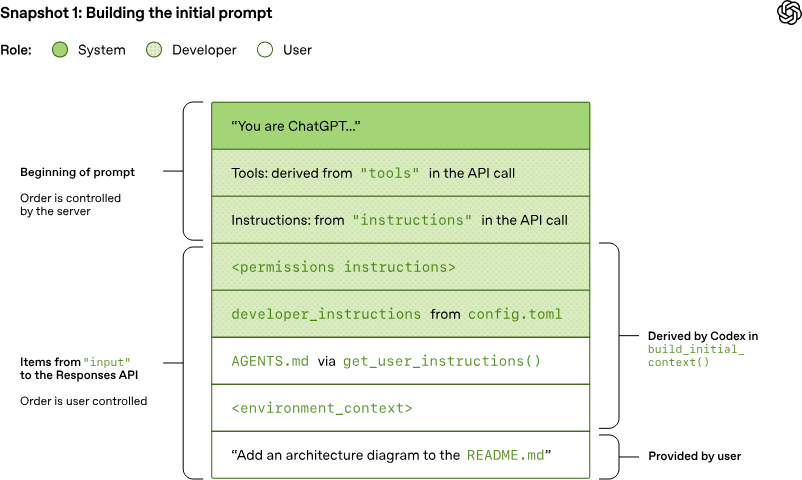

Prompt trong Codex không chỉ là input của người dùng. Nó bao gồm nhiều lớp:

- Ngữ cảnh môi trường (thư mục, shell)

- File AGENTS.md (quy tắc dự án)

- Quyền sandbox

- Hướng dẫn developer

- Định nghĩa tool

- System message

Nguồn: OpenAI Engineering Blog

Prompt tăng kích thước rất nhanh vì mỗi lần tương tác đều thêm dữ liệu mới.

Dữ liệu gửi đi tăng theo cấp số nhân, nhưng OpenAI chấp nhận điều này để đảm bảo mỗi request độc lập và hỗ trợ zero data retention.

Để tối ưu, họ sử dụng prompt caching: tái sử dụng phần prompt cũ.

Khi vượt giới hạn context window, hệ thống sẽ nén hội thoại để giữ lại ý nghĩa chính.

File AGENTS.md giúp cung cấp ngữ cảnh dự án mà không cần hardcode vào hệ thống.

Hoạt động trên nhiều nền tảng

Codex bắt đầu là công cụ CLI, sau đó mở rộng sang VS Code, web, macOS và nhiều IDE khác.

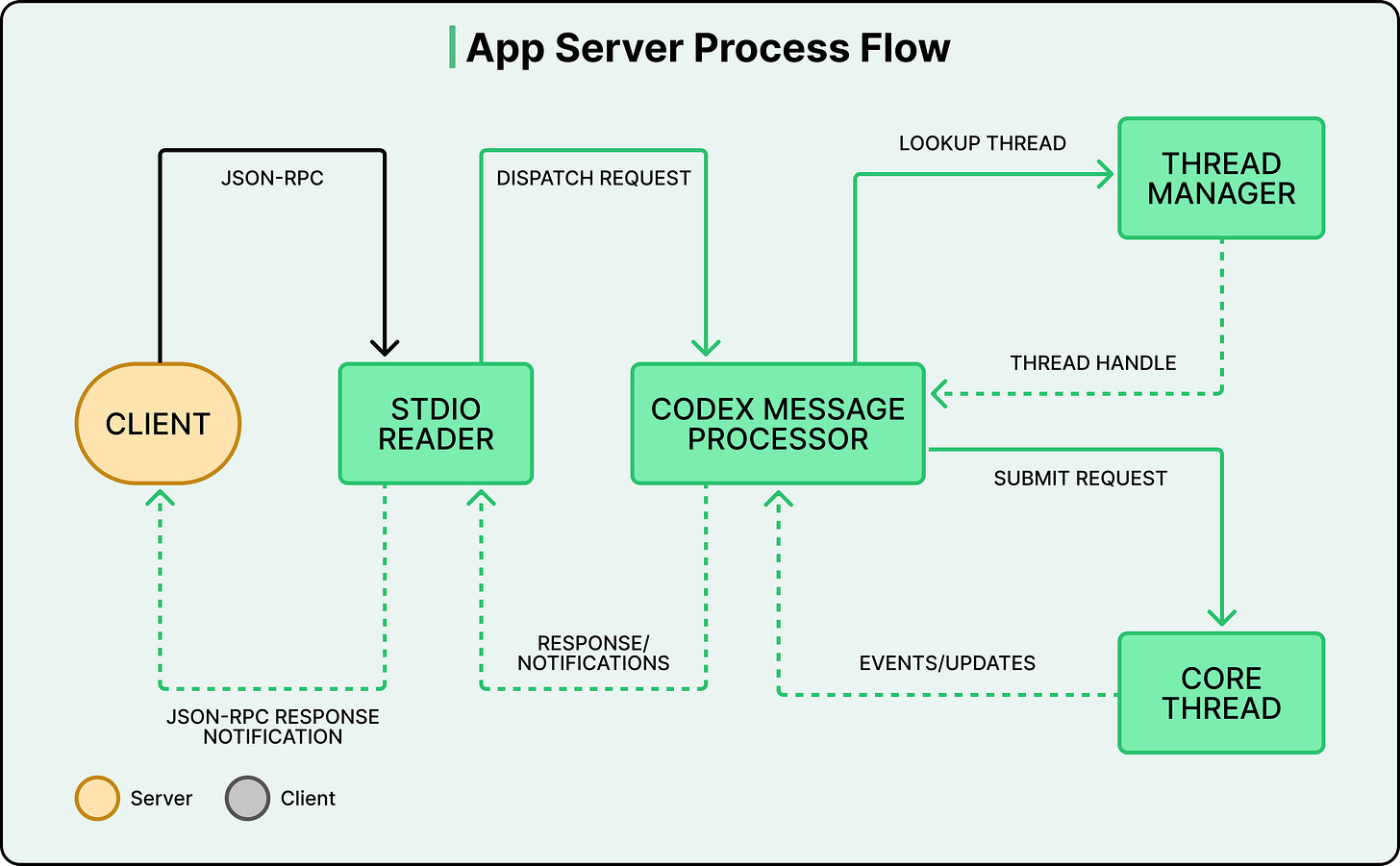

Để tránh viết lại logic nhiều lần, OpenAI xây dựng một App Server.

Toàn bộ logic agent nằm trong Codex core và được expose qua JSON-RPC.

Các client (CLI, IDE, web) chỉ cần giao tiếp với server này.

Nhờ đó, Codex có thể hoạt động nhất quán trên nhiều nền tảng mà không cần viết lại từ đầu.

Ban đầu, Codex được xây dựng như một công cụ CLI chạy trong terminal, thao tác trực tiếp trên codebase local của bạn.

Sau đó, OpenAI cần đưa Codex vào VS Code, rồi đến web app, ứng dụng desktop macOS và cả các IDE bên thứ ba như JetBrains và Xcode. Việc viết lại toàn bộ logic agent cho từng nền tảng là không khả thi.

Như đã đề cập, họ từng thử expose Codex thông qua MCP. Tuy nhiên, MCP không đủ linh hoạt để xử lý các tương tác phức tạp của một agent thực thụ.

Codex cần:

- Streaming tiến trình theo thời gian thực khi model đang suy luận

- Tạm dừng giữa chừng để xin xác nhận từ người dùng trước khi chạy lệnh

- Trả về diff code có cấu trúc

Những yêu cầu này vượt quá khả năng của MCP tại thời điểm đó.

Giải pháp là xây dựng một lớp trung gian mới: App Server.

Toàn bộ logic cốt lõi của agent—bao gồm agent loop, quản lý thread, thực thi tool, cấu hình và xác thực—được đặt trong một hệ thống duy nhất gọi là “Codex core”.

App Server bọc Codex core này lại và expose nó thông qua giao thức JSON-RPC, cho phép bất kỳ client nào cũng có thể giao tiếp thông qua standard input/output.

Điều này có nghĩa là:

- CLI chỉ là một client

- VS Code extension là một client

- Web app cũng là một client

Tất cả đều nói chuyện với cùng một backend.

Kiến trúc này giúp OpenAI tránh việc phải nhân bản logic agent ở nhiều nơi, đồng thời đảm bảo hành vi nhất quán trên mọi nền tảng.

Quan trọng hơn, nó cho phép hệ thống phát triển nhanh hơn, vì mọi cải tiến đều chỉ cần thực hiện một lần ở Codex core.

Tổng kết

Điểm quan trọng nhất khi hiểu về Codex là: mô hình AI chỉ là một phần của hệ thống.

Giá trị thực sự nằm ở lớp orchestration xung quanh nó:

- Vòng lặp agent giúp mô hình tương tác với môi trường

- Hệ thống prompt và quản lý context xử lý độ phức tạp của hội thoại

- Kiến trúc multi-surface giúp một agent hoạt động trên nhiều nền tảng

Những quyết định kỹ thuật này là yếu tố quyết định biến một mô hình AI thành một công cụ thực sự hữu ích cho lập trình viên.

Codex không chỉ là một model viết code. Nó là một hệ thống hoàn chỉnh, nơi AI, hạ tầng và trải nghiệm người dùng được kết hợp chặt chẽ để giải quyết các vấn đề thực tế trong phát triển phần mềm.