Trong số mới nhất của The AI Lab Newsletter, tôi đã giới thiệu một đoạn clip Seedance 2.0 của ByteDance: hai người đàn ông chơi tennis trông như đang ở một giải ATP. Siêu chân thực. Nếu không biết trước, có lẽ tôi cũng không nhận ra đó không phải video thật. Nhưng một đồng nghiệp từng chơi tennis bán chuyên xem xong lại nói: “Cú trái tay đó không tồn tại. Không ai đánh như vậy cả.” Kiến thức chuyên môn của anh ấy đã phát hiện ra lỗi mà gần như tất cả mọi người khác đều bị đánh lừa.

Chúng tôi đã có một cuộc thảo luận dài về ý nghĩa của điều này. AI có thể đạt đến mức 95% hoặc 98% trong việc tạo ra thứ trông hoàn hảo — nhưng vẫn không hoàn hảo. Và nếu bạn có chuyên môn sâu, bạn sẽ nhận ra ngay lập tức. Câu chuyện phổ biến hiện nay cho rằng đây chỉ là hạn chế tạm thời. Nhưng có thể nó mang tính cấu trúc. Và nếu nhìn vào bằng chứng, bạn sẽ thấy một kết luận trái chiều: chuyên môn đang tăng giá trị, không phải giảm đi, chính vì AI có một “trần chất lượng” mà nó khó vượt qua.

Tiệm cận trần chất lượng của AI

Tôi từng viết về công trình của Sara Hooker liên quan đến lợi suất giảm dần khi scale. Góc nhìn đầu tư — như việc các hyperscaler chi 690 tỷ USD capex để đổi lấy 4% doanh thu — đã được nói nhiều. Nhưng ít ai phân tích rõ vì sao chất lượng đầu ra của AI chạm trần, và vì sao đó là vấn đề cấu trúc chứ không phải tạm thời.

Ben Affleck, một cách bất ngờ, đã đưa ra lời giải thích dễ hiểu nhất trong một tập của The Joe Rogan Experience vào tháng 1/2026:

Nếu bạn nhờ ChatGPT hay Claude hay Gemini viết gì đó, nó rất tệ. Nó tệ vì bản chất của nó là đi về trung bình. Nó có thể hữu ích như một công cụ cho người viết… nhưng tôi không nghĩ nó có thể tạo ra thứ gì thực sự có ý nghĩa, hay tự làm ra phim từ đầu. Điều đó là vô lý.

Ông ấy đúng hơn ông ấy nghĩ. Sự hội tụ về trung bình không phải là vấn đề có thể giải quyết đơn giản bằng kỹ thuật. Nó xảy ra ở ba tầng khác nhau:

(1) Toán học của dự đoán token tiếp theo. LLM tạo ra chuỗi có xác suất cao nhất. Mà “xác suất cao” nghĩa là “trung bình”. Mô hình không cố tạo ra kết quả tốt nhất, mà là kết quả “được kỳ vọng nhất”. Những thứ xuất sắc thường nằm ở phần đuôi của phân phối — nơi mô hình né tránh.

(2) RLHF làm mọi thứ tệ hơn. Người đánh giá thường thích câu trả lời quen thuộc. Hàm thưởng học được ưu tiên tính “điển hình” (α=0.57). Mô hình bị huấn luyện để nghe “quen tai” thay vì thực sự đúng hoặc xuất sắc.

(3) Sự sụp đổ mô hình (model collapse). Khi mô hình học từ dữ liệu do AI tạo ra, nó dần “quên” phân phối dữ liệu thật. Phần đuôi biến mất trước. Kết quả là toàn bộ hệ thống hội tụ về một điểm trung bình với ít biến thiên.

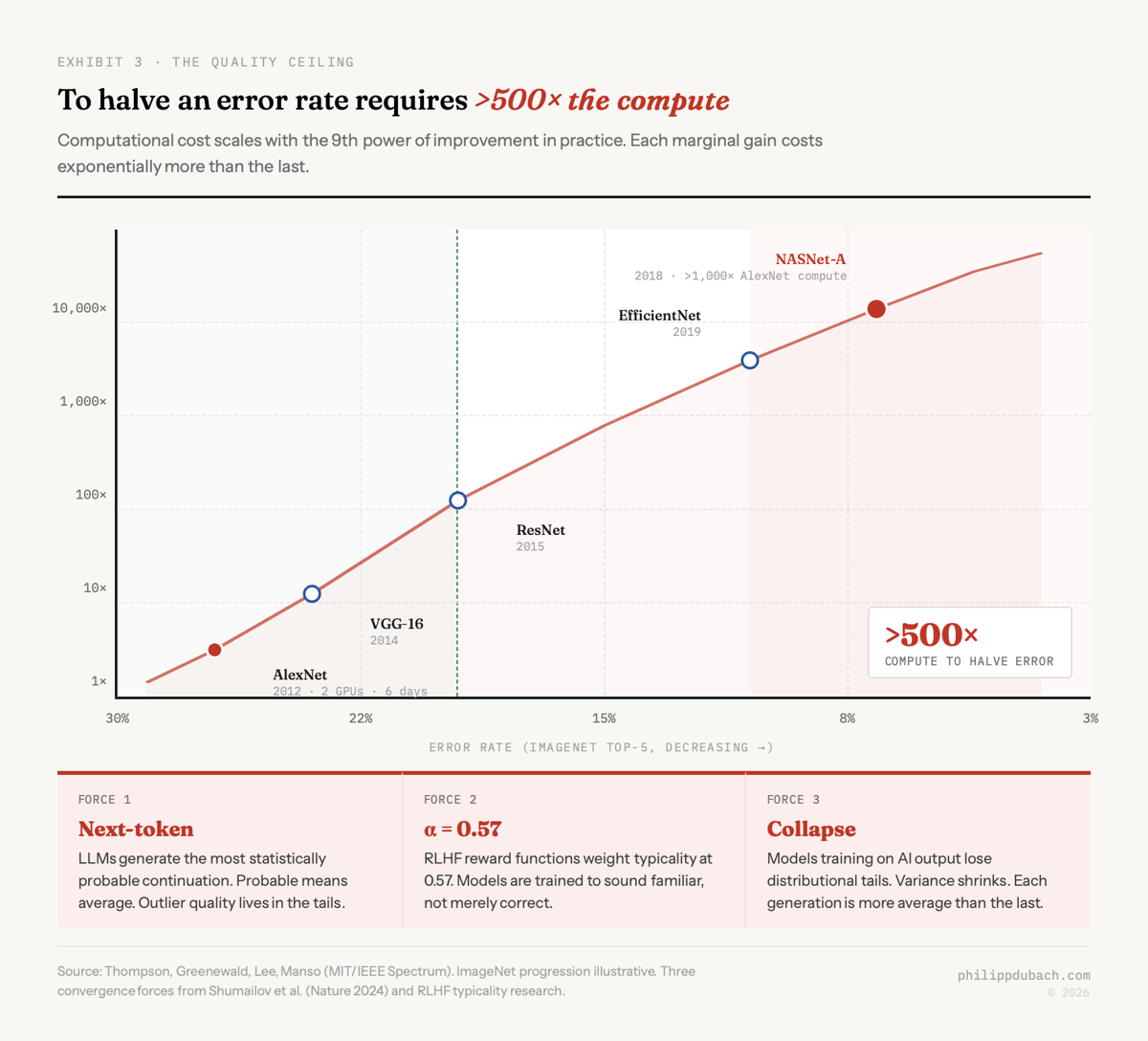

Các nhà nghiên cứu MIT đã chỉ ra chi phí: để cải thiện chất lượng, tài nguyên tính toán tăng theo lũy thừa bậc 4 về lý thuyết và bậc 9 trong thực tế. Muốn giảm một nửa lỗi cần hơn 500 lần tài nguyên.

Affleck mô tả hệ quả kinh tế rất chính xác:

ChatGPT 5 chỉ tốt hơn khoảng 25% so với ChatGPT 4, nhưng chi phí điện và dữ liệu lại gấp 4 lần.

Mỗi cải tiến nhỏ đều đắt hơn theo cấp số nhân. Đường cong chi phí ngày càng “bẻ cong” ra xa.

Bài kiểm tra cuối cùng của nhân loại

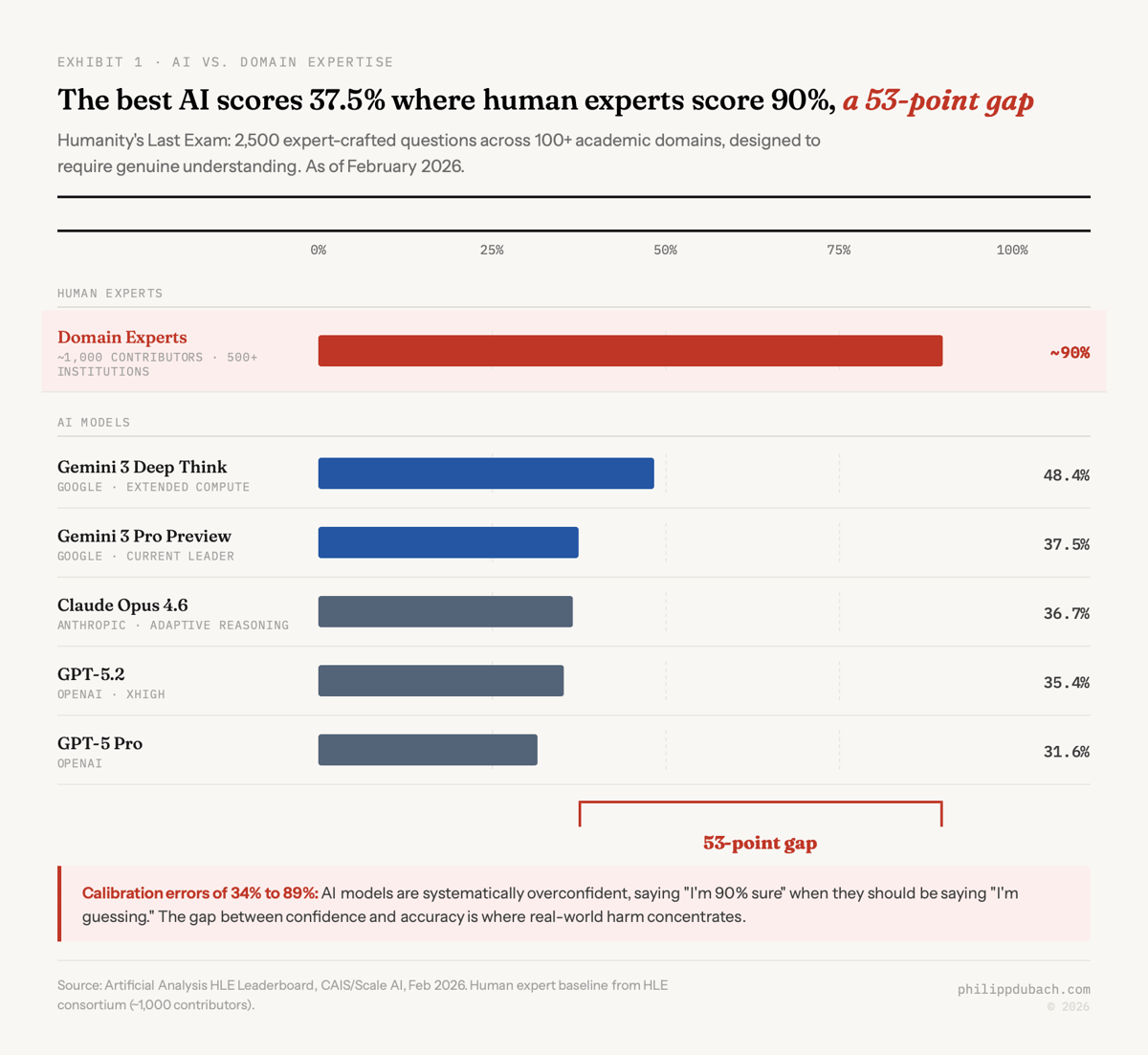

Thước đo rõ nhất về khoảng cách giữa AI và chuyên môn là Humanity’s Last Exam (HLE), công bố năm 2025.

Bài test gồm 2.500 câu hỏi từ hơn 100 lĩnh vực, được thiết kế để không thể “tra Google”.

Đến tháng 2/2026:

-

Model tốt nhất đạt 37.5%

-

Đa số model dưới 30%

-

Chuyên gia con người ~90%

Một khoảng cách 53 điểm.

AI cũng cực kỳ tự tin sai. Sai lệch calibration từ 34% đến 89%. Tức là AI nói “tôi chắc 90%” trong khi thực tế chỉ đang đoán.

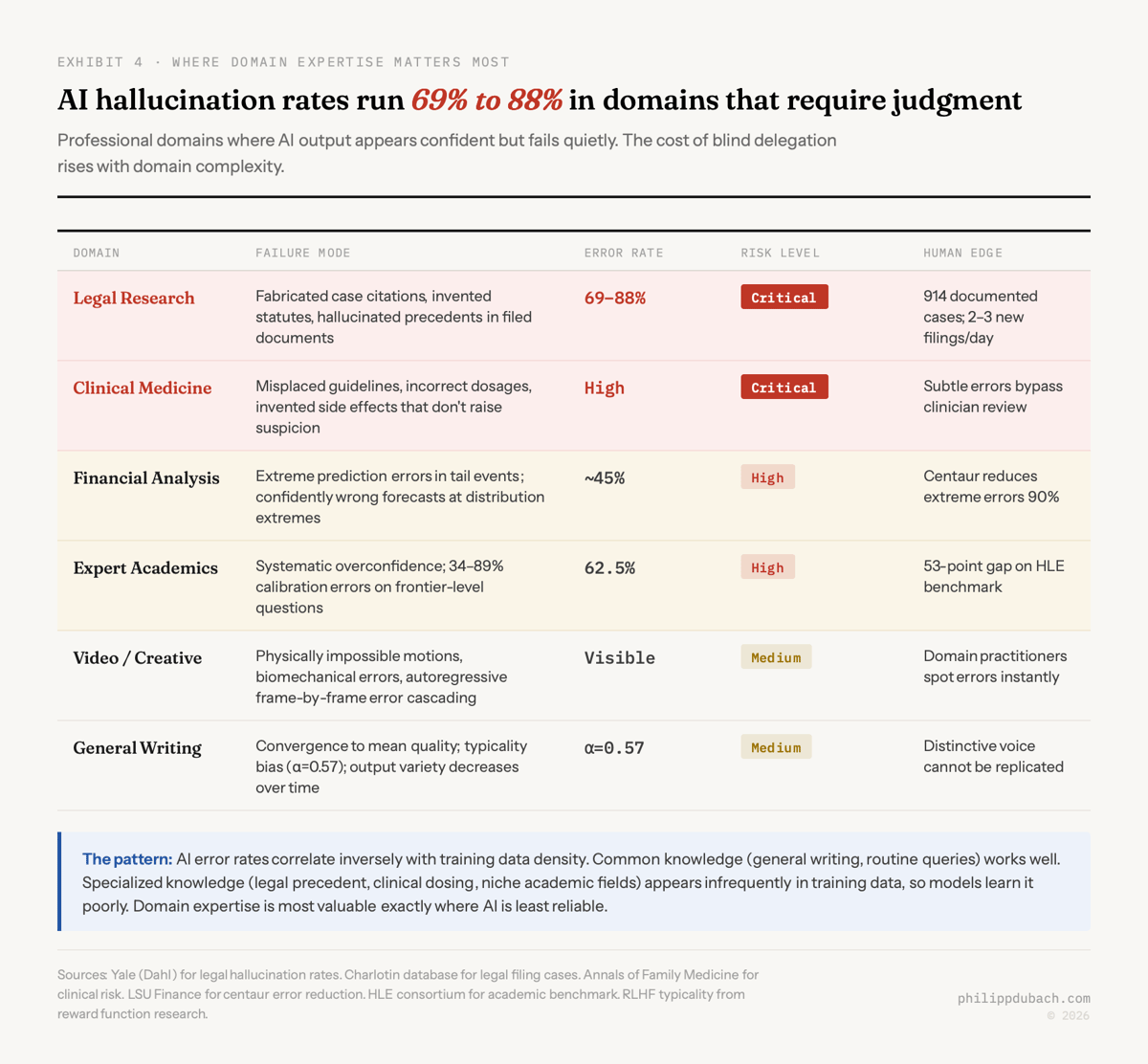

Trong luật, tỷ lệ “hallucination” lên tới 69–88%. Trong y khoa, lỗi nhỏ như sai liều thuốc có thể không bị phát hiện ngay. Đây không phải edge case — mà là hành vi mặc định khi dữ liệu huấn luyện thiếu.

Lý do cấu trúc: AI học tốt những gì phổ biến, nhưng học rất kém kiến thức hiếm. Neural network là bộ nội suy tốt, nhưng ngoại suy rất kém.

Người đồng nghiệp của tôi có “mô hình vật lý” trong đầu về chuyển động cơ thể. AI thì chỉ có xác suất. Đó là khoảng cách.

Mô hình centaur: hợp tác người + AI

Cách nhìn phổ biến cho rằng AI sẽ thay thế con người. Nhưng dữ liệu thực nghiệm lại cho thấy điều ngược lại.

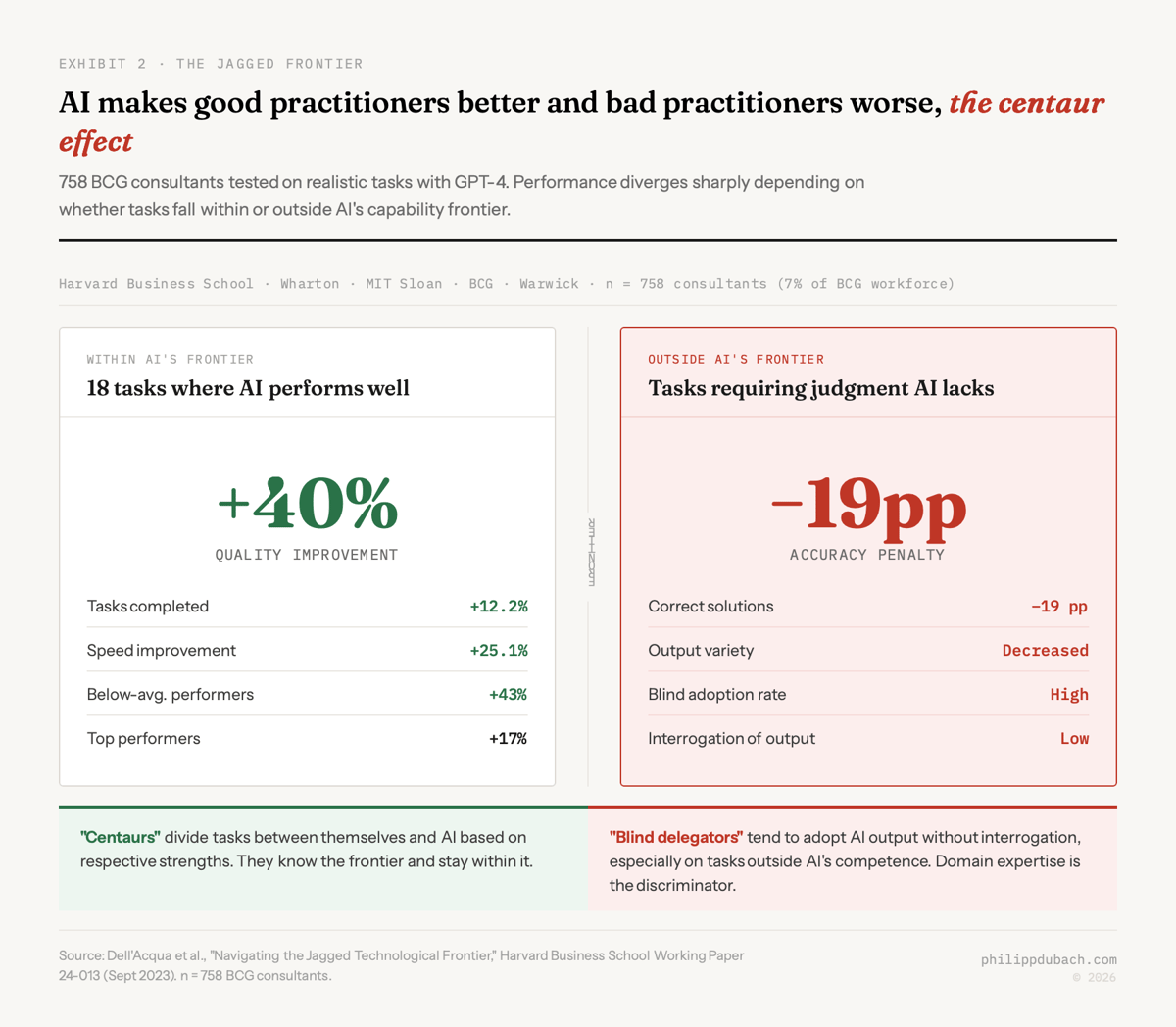

Nghiên cứu Harvard/BCG với 758 consultant:

-

+12.2% số task

-

Nhanh hơn 25.1%

-

Chất lượng +40%

Nhưng khi vượt ngoài khả năng của AI:

-

Hiệu suất giảm 19 điểm phần trăm

Vấn đề là: giá trị của con người nằm ở việc biết khi nào AI sai.

Nghiên cứu khác cho thấy:

-

AI tốt hơn con người trong 54.5% trường hợp

-

Nhưng human + AI tốt hơn AI đơn lẻ ~55%

-

Giảm lỗi cực đoan ~90%

Thứ con người đóng góp là khả năng xử lý “trường hợp biên”.

AI sẽ giỏi xử lý những phần tốn kém và nhàm chán, nhưng vẫn cần yếu tố sáng tạo của con người.

Nghiên cứu kinh tế cũng cho thấy hiệu ứng bổ trợ lớn hơn hiệu ứng thay thế 1.7 lần.

Deskilling: cái bẫy nguy hiểm

Nếu người mới phụ thuộc AI trước khi có kinh nghiệm:

-

Họ không phát triển trực giác

-

Không nhận ra khi AI sai

-

Phụ thuộc hoàn toàn vào AI

Gartner dự đoán đến 2030, một nửa doanh nghiệp sẽ thiếu kỹ năng nghiêm trọng vì automation.

Đây là vòng lặp nguy hiểm:

-

Ít kỹ năng hơn

-

Phụ thuộc AI nhiều hơn

-

Chi phí tăng

Rủi ro không phải là mất việc. Mà là mất năng lực.

David Autor có góc nhìn tích cực hơn: AI có thể mở rộng giá trị chuyên môn con người. Nhưng điều đó chỉ đúng nếu ta dùng AI để tăng cường năng lực — không phải thay thế nó.

Sự khác biệt giữa tăng 43% năng suất và giảm 19 điểm hiệu suất nằm ở một thứ: phán đoán.

Và phán đoán chỉ đến từ trải nghiệm.

Kết luận

AI không thay thế chuyên môn. Nó khuếch đại nó.

Người giỏi sẽ giỏi hơn.

Người kém sẽ kém hơn.

Câu chuyện “AI sẽ thay thế tất cả” là narrative của ngành.

Dữ liệu lại kể một câu chuyện khác: hợp tác.

Khả năng nhận ra “cú trái tay không thể tồn tại” không biến mất.

Nó ngày càng có giá trị hơn.

Chúng tôi đã có một cuộc trò chuyện dài về điều đó. AI có thể đạt tới khoảng 95% hoặc 98% trong việc tạo ra thứ trông hoàn hảo, nhưng rồi nó vẫn không hoàn hảo. Và nếu bạn có kiến thức chuyên sâu, bạn sẽ nhận ra ngay lập tức. Câu chuyện phổ biến hiện nay coi đây là một hạn chế tạm thời. Nhưng nó có thể là cấu trúc. Và tôi nghĩ rằng các bằng chứng, khi bạn nhìn toàn bộ, dẫn đến một kết luận thực sự trái chiều: chuyên môn đang tăng giá trị, không giảm, chính vì AI chạm đến một trần chất lượng mà nó khó vượt qua.

Sự hội tụ về trung bình không phải là một vấn đề kỹ thuật có thể giải quyết đơn giản. Nó hoạt động ở ba tầng riêng biệt, mỗi tầng lại khuếch đại tầng kia.

(1) Toán học của việc dự đoán token tiếp theo. LLM tạo ra phần tiếp theo có xác suất cao nhất. Mà “xác suất cao” theo định nghĩa chính là “trung bình”. Mô hình không cố tạo ra output tốt nhất; nó tạo ra output được kỳ vọng nhất dựa trên phân phối đã học. Chất lượng vượt trội — thứ làm nên sự khác biệt — nằm ở phần đuôi của phân phối. Nhưng kiến trúc của mô hình lại né tránh chính phần đuôi đó.

(2) RLHF khiến mọi thứ tệ hơn. Nghiên cứu cho thấy người đánh giá con người thích những câu trả lời nghe quen thuộc. Hàm thưởng học được đặt trọng số cho tính điển hình ở mức α=0.57. Nói cách khác, mô hình được huấn luyện để nghe “bình thường” thay vì thực sự đúng hoặc xuất sắc. Tín hiệu reinforcement kéo output về trung tâm của phân phối chất lượng, không phải về phía đỉnh.

(3) Model collapse. Nghiên cứu của Shumailov và cộng sự cho thấy khi mô hình ngày càng học từ dữ liệu do AI tạo ra, nó “quên” phân phối dữ liệu gốc, mất phần đuôi trước và hội tụ về một điểm trung bình với phương sai rất nhỏ. Internet đang tràn ngập nội dung do AI tạo ra. Thế hệ model tiếp theo lại học từ chính dữ liệu đó. Phần đuôi càng co lại. Đây là một vòng lặp phản hồi dương nhưng theo hướng xấu.

Chi phí tính toán cũng tăng theo cấp số mũ. Để giảm một nửa tỷ lệ lỗi cần hơn 500 lần tài nguyên. Điều đó giải thích tại sao việc vượt qua “trần chất lượng” ngày càng khó.

Điều quan trọng là: đây không chỉ là vấn đề kỹ thuật. Nó là vấn đề kinh tế và cấu trúc.

Hệ quả thương mại là rõ ràng: mỗi cải tiến nhỏ trở nên cực kỳ đắt đỏ. Bạn có thể cải thiện model thêm một chút, nhưng chi phí tăng theo cấp số nhân.

Điều này dẫn đến một thực tế: AI có thể tiến gần đến hoàn hảo, nhưng rất khó — hoặc không thể — vượt qua ngưỡng đó một cách hiệu quả.

Và đó là nơi chuyên môn con người xuất hiện.

Trong các lĩnh vực chuyên sâu, AI không chỉ kém — mà còn tự tin sai. Nó không biết rằng nó sai. Và đó mới là vấn đề thực sự.

Sự khác biệt giữa người và AI không nằm ở việc tạo ra output trông hợp lý. Mà nằm ở khả năng phát hiện điều không hợp lý.

Người đồng nghiệp của tôi không cần phân tích xác suất. Anh ấy chỉ cần nhìn và biết: cú đánh đó là không thể.

Đó là tri thức hiện thân (embodied knowledge) — thứ mà dữ liệu không thể truyền tải hoàn toàn.

AI có thể nội suy. Con người có thể ngoại suy.

Đó là khoảng cách.

Khi bạn đặt AI vào môi trường thực tế, đặc biệt là các lĩnh vực chuyên môn cao, sai số không chỉ là bug — nó là rủi ro hệ thống.

Trong luật, y học, tài chính — những sai lệch nhỏ có thể dẫn đến hậu quả lớn.

Và vì AI có xu hướng tự tin sai, rủi ro càng lớn hơn.

Điều này dẫn đến một kết luận quan trọng:

Giá trị của con người không nằm ở việc tạo ra output, mà nằm ở việc đánh giá output.

Đó là lý do mô hình centaur (human + AI) vượt trội hơn AI đơn lẻ.

Nhưng chỉ khi con người đủ giỏi để biết khi nào AI sai.

Nếu không, AI không giúp bạn — nó làm bạn tệ hơn.

Đây là điểm mà narrative phổ biến bỏ qua.

AI không tự động nâng cao chất lượng công việc.

Nó khuếch đại năng lực hiện có.

Nếu bạn giỏi, bạn trở nên rất giỏi.

Nếu bạn không giỏi, bạn trở nên tự tin sai.

Đó là lý do deskilling là một cái bẫy nguy hiểm.

Nếu bạn dựa vào AI quá sớm, bạn sẽ không phát triển trực giác.

Và khi AI sai — bạn không nhận ra.

Điều này tạo ra một vòng lặp nguy hiểm:

-

Kỹ năng giảm

-

Phụ thuộc AI tăng

-

Khả năng kiểm soát giảm

Kết quả không phải là mất việc.

Mà là mất năng lực thực sự.

Trong dài hạn, điều này làm suy yếu toàn bộ hệ thống.

Vì mô hình centaur chỉ hoạt động khi con người đủ giỏi.

Nếu không, bạn chỉ còn lại AI — với tất cả những hạn chế của nó.

Và đó là một hệ thống kém hơn.

Do đó, chiến lược đúng không phải là “thay thế con người bằng AI”.

Mà là:

-

Tăng cường chuyên môn

-

Kết hợp với AI

-

Giữ con người trong vòng lặp

AI là một công cụ.

Không phải là sự thay thế.

Nó mở rộng năng lực.

Nhưng không tạo ra năng lực.

Và đó là điểm mà rất nhiều người đang hiểu sai.

Kết luận cuối cùng rất đơn giản:

Khả năng nhận ra “cú trái tay không thể tồn tại” không biến mất.

Nó ngày càng trở nên giá trị hơn.